대학원생 논문 AI 도구, Academic Research Skills 써볼 만할까?

Academic Research Skills를 Claude Code와 Codex에서 쓰는 법, 문헌리뷰·인용검증·연구윤리 활용법까지 정리했다.

빠른 결론

먼저 이렇게 보면 됩니다

약 37분 읽기한 줄 판단

Academic Research Skills를 Claude Code와 Codex에서 쓰는 법, 문헌리뷰·인용검증·연구윤리 활용법까지 정리했다.

- 읽을 사람

- 지금 바로 문제를 해결해야 하는 독자

- 확인 기준

- Academic Research Skills · Claude Code · Codex

- 주의할 점

- 가격과 기능은 바뀔 수 있습니다. 공식 안내도 함께 확인하세요.

3줄 요약

- Academic Research Skills는 논문을 대신 써주는 도구가 아니라, 연구 질문·문헌리뷰·인용 검증·피어리뷰 대비를 단계화한 Claude Code용 연구 스킬 묶음이다.

- 2026년 5월 12일 확인 기준 Claude 본류는 v3.7.0, Codex sibling 배포판은 v0.1.6이다. Codex 사용자는 원본 repo를 억지로 옮기기보다 sibling 배포판을 보는 편이 맞다.

- 대학생과 대학원생에게 가장 좋은 사용법은 “대필”이 아니라 “더 자주 검증하게 만드는 연구 보조 루프”로 쓰는 것이다.

목차

- Academic Research Skills는 무엇을 해주는 도구일까?

- Claude Code용인데 Codex에서도 쓸 수 있을까?

- 설치는 Claude와 Codex에서 어떻게 다를까?

- 대학생과 대학원생은 어디에 먼저 써야 할까?

- 문헌리뷰 AI로 쓰면 어디서 위험해질까?

- 인용 검증과 연구윤리는 어떻게 지켜야 할까?

- NotebookLM, Zotero, 일반 챗봇과는 어떻게 나눠 써야 할까?

- 한계와 라이선스는 무엇을 조심해야 할까?

- FAQ

- 결론: 논문을 빨리 쓰는 도구보다, 덜 틀리게 만드는 도구다

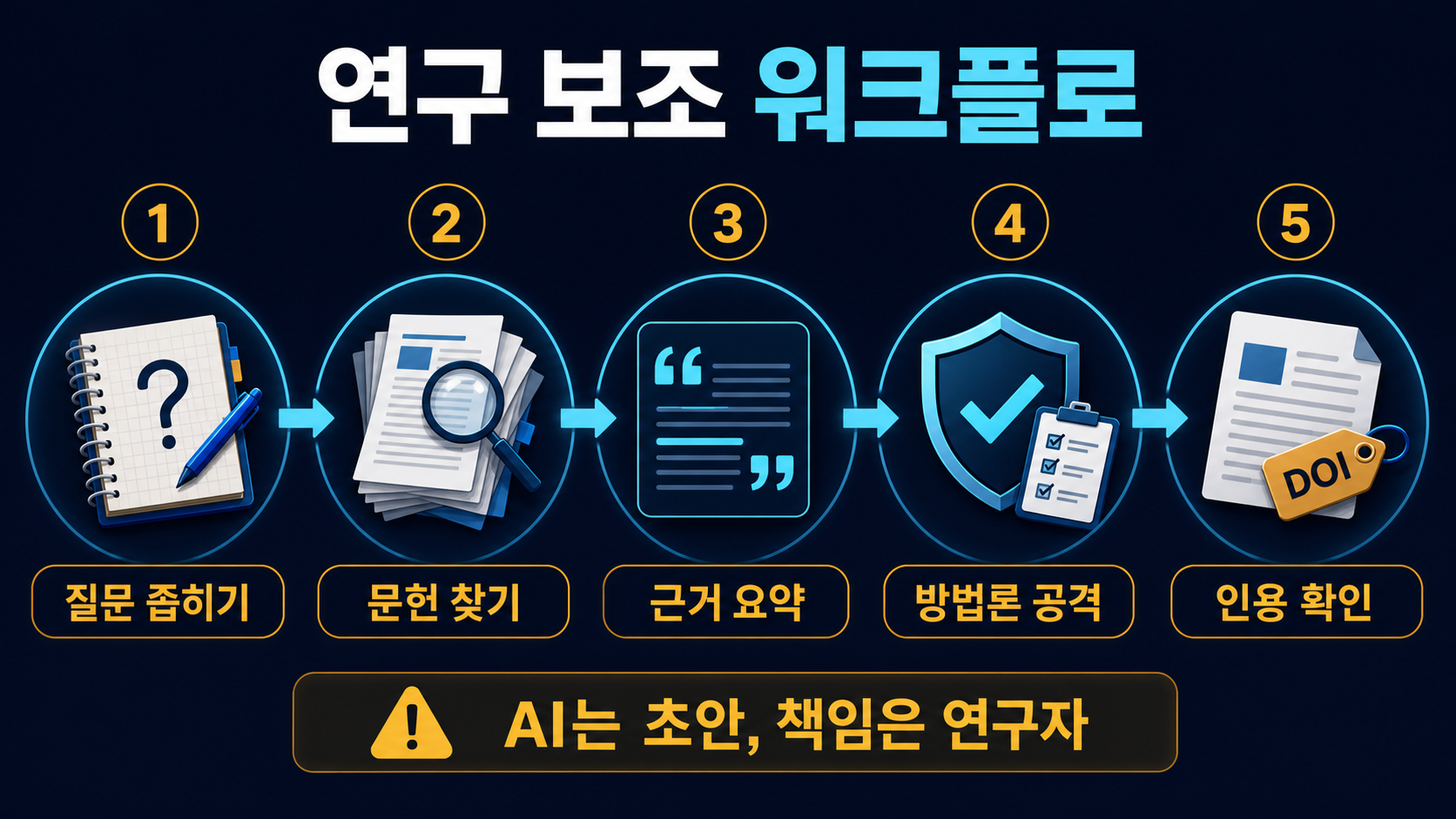

결론부터 말하면, Academic Research Skills는 대학생·대학원생에게 꽤 흥미로운 도구다. 다만 기대값을 정확히 잡아야 한다. 이건 “AI가 내 논문을 대신 써주는 자동 논문 공장”이 아니다. 연구 질문을 좁히고, 문헌을 정리하고, 인용을 다시 확인하고, 심사위원 관점에서 초안을 공격하게 만드는 연구 운영체제에 가까운 스킬 묶음이다.

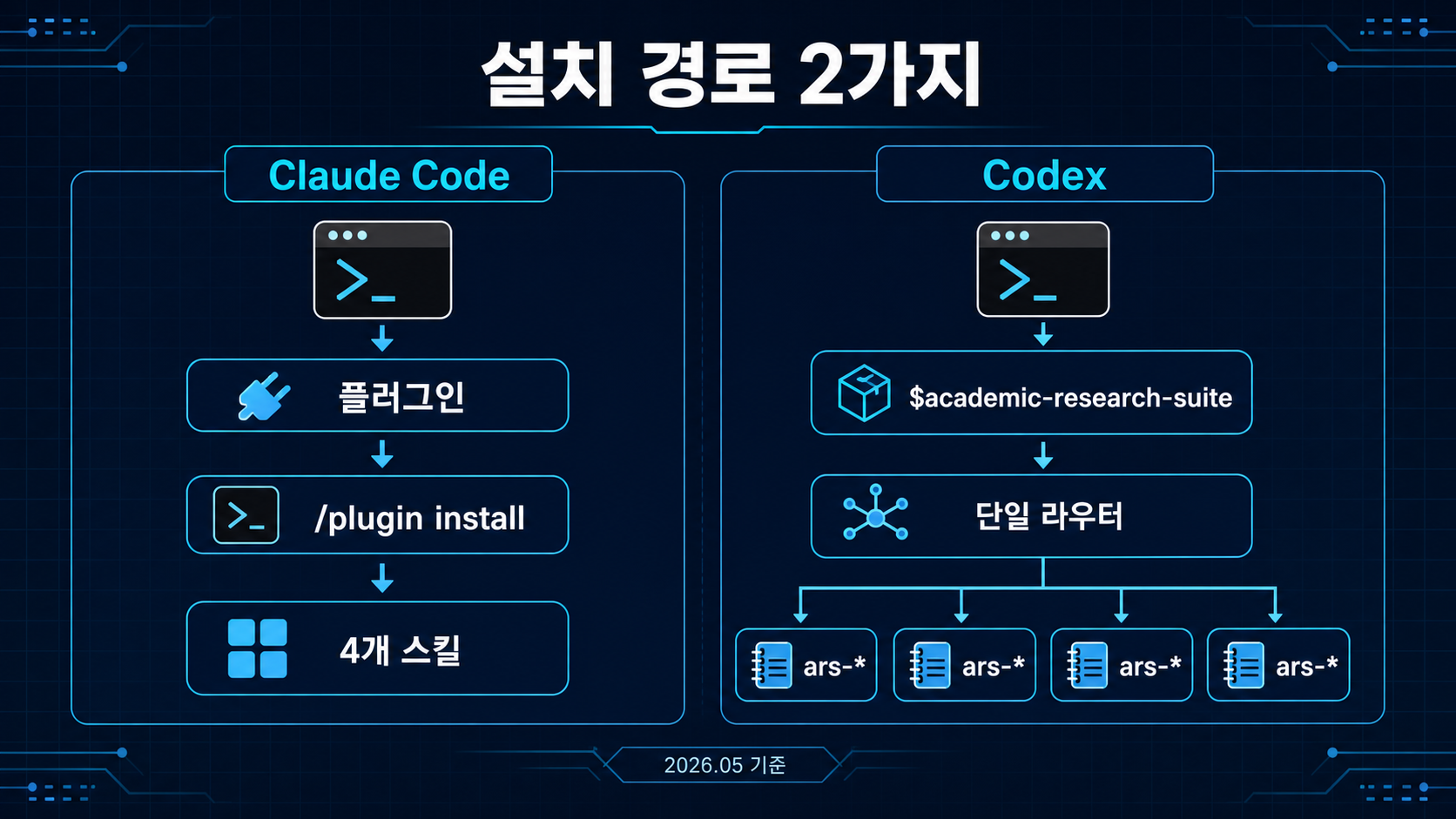

특히 중요한 점은 Claude Code용 본류와 Codex용 sibling 배포판이 갈라져 있다는 것이다. 원본 repo의 README는 Claude Code 플러그인 설치를 안내하면서, Codex CLI 사용자는 별도 academic-research-skills-codex 배포판을 쓰라고 명시한다 (출처: academic-research-skills README, academic-research-skills-codex). 그래서 이 글은 “Claude에서 쓰는 것을 Codex에 억지 이식하는 법”이 아니라, 같은 연구 워크플로가 Claude와 Codex에서 어떻게 다르게 포장되는지에 초점을 둔다.

Academic Research Skills는 무엇을 해주는 도구일까?

한 줄로 줄이면, Academic Research Skills는 Claude Code 안에서 연구 → 논문 작성 → 리뷰 → 수정 → 최종화까지 이어지는 학술 연구 워크플로를 스킬로 묶은 프로젝트다.

논문 대필 도구가 아니라 연구 파이프라인이다

원문 README의 핵심 문장은 분명하다. AI는 “copilot, not the pilot”이라는 관점이다. 즉 AI가 논문을 대신 쓰는 것이 아니라, 참고문헌 찾기, 인용 형식 점검, 데이터와 논리 일관성 확인 같은 반복 작업을 줄이고, 연구 질문·방법·해석은 사람이 책임진다는 구조다 (출처: academic-research-skills README).

이 관점은 대학생과 대학원생에게 중요하다. “논문 작성 AI”라는 검색어로 들어오면 대개 빠른 초안, 문장 다듬기, 표절 회피 같은 기대가 따라붙는다. 하지만 실제로 위험한 지점은 문장을 예쁘게 못 쓰는 것이 아니라, 존재하지 않는 논문을 인용하거나, 방법론의 빈틈을 못 보고, 지도교수나 심사위원이 물을 질문을 미리 맞아보지 않는 것이다.

이 글은 Academic Research Skills를 “학술 대필 도구”가 아니라 “검증 루프를 반복 가능하게 만드는 에이전트 워크플로”로 본다. 이 기준을 잡아야 장점과 한계가 같이 보인다.

네 가지 큰 축으로 나뉜다

원본 repo는 크게 deep-research, academic-paper, academic-paper-reviewer, academic-pipeline 네 흐름을 제공한다. 여기에 Codex sibling 배포판은 experiment-agent까지 함께 벤더링해 단일 $academic-research-suite 스킬로 라우팅한다 (출처: Codex sibling README).

| 흐름 | 주요 역할 | 학생에게 맞는 사용 장면 |

|---|---|---|

| deep-research | 연구 질문 정리, 문헌 탐색, 체계적 문헌고찰 | 주제가 넓고 어디서 시작할지 모를 때 |

| academic-paper | 아웃라인, 초안, 초록, 인용 형식, AI 사용 공개 | 논문 구조를 잡고 작성 계획을 세울 때 |

| academic-paper-reviewer | 심사위원식 리뷰, 방법론 공격, 수정 로드맵 | 제출 전 약점을 찾고 싶을 때 |

| academic-pipeline | 연구부터 최종화까지 단계 관리 | 장기 프로젝트를 체크포인트로 관리할 때 |

| experiment-agent | 실험 계획, 통계 해석, 재현성 점검 | 코드 실험이나 human study를 별도로 관리할 때 |

왜 대학생보다 대학원생에게 더 먼저 맞을까?

학부생도 졸업논문, 캡스톤, 리서치 페이퍼에서 도움을 받을 수 있다. 하지만 이 도구가 가장 잘 맞는 독자는 연구 질문, 선행연구, 방법론, 피어리뷰, 인용 규칙이 모두 압박으로 오는 대학원생이다.

검색어로는 대학원생 AI 도구, 문헌리뷰 AI, 선행연구 조사 AI, Claude Code 논문 작성 쪽이 더 강하다. repo명인 Academic Research Skills 자체는 아직 한국어 검색 인지도가 낮기 때문에, 글을 읽는 독자 입장에서는 “이게 내 논문 워크플로 어디에 들어오나”가 먼저다.

국내 수요도 완전히 추상적인 이야기는 아니다. 성균관대 대학원 비교과 프로그램에는 Claude Code를 선행연구 조사, 학술 글쓰기, 데이터 분석 보조에 연결하는 특강이 올라와 있고, 서울대 도서관 연구가이드도 AI와 연구·출판 윤리 항목을 별도로 다룬다 (출처: 성균관대 대학원 Claude Code 특강 공지, 서울대 연구가이드).

Claude Code용인데 Codex에서도 쓸 수 있을까?

쓸 수 있다. 단, 원본 Claude repo를 그대로 Codex에 넣는 방식이 아니라, Codex용 sibling 배포판을 쓰는 것이 맞다.

원본은 Claude Code 플러그인이다

원본 README는 Claude Code CLI, VS Code, JetBrains 환경에서 다음 흐름으로 설치하라고 안내한다 (출처: academic-research-skills README, Claude Code plugin marketplaces docs).

/plugin marketplace add Imbad0202/academic-research-skills

/plugin install academic-research-skillsClaude Code 쪽에서는 /ars-plan, /ars-lit-review, /ars-full 같은 슬래시 명령을 플러그인 방식으로 노출한다. 이미 클로드 코드 완전 정복을 읽은 독자라면, Claude Code가 단순 챗봇보다 프로젝트 안에서 명령과 파일, 규칙을 함께 다루는 도구라는 점을 떠올리면 된다.

Codex는 단일 라우터 스킬이다

Codex sibling repo는 구조가 다르다. skills/academic-research-suite/SKILL.md 하나가 루트 라우터이고, 원본 ARS의 워크플로·프롬프트·참조 문서를 그 아래에 벤더링한다. Codex 공식 문서도 스킬을 SKILL.md, scripts/, references/, assets/로 구성되는 재사용 워크플로 형식이라고 설명한다 (출처: OpenAI Codex Skills, academic-research-skills-codex README).

Codex에서의 호출은 대체로 이런 모양이다.

Use $academic-research-suite.

Goal: write a journal article.

Current materials: I have a literature matrix and rough findings, but no outline.

Output needed now: paper architecture and missing-evidence checklist.

Constraints: English, APA 7, higher education policy audience.원본 Claude의 /ars-plan 같은 명령은 Codex에서 네이티브 slash command로 등록되는 것이 아니라, sibling 배포판의 라우터가 ars-plan 같은 별칭을 해석하는 방식이다. 작은 차이 같지만 실제 사용에서는 중요하다. Codex는 현재 대화의 모델, 파일 권한, 로컬 스킬 규칙을 따르고, Claude용 hook은 실행되지 않는다.

같은 내용, 다른 런타임이라고 보면 된다

이 차이는 카파시가 경고한 AI 코딩의 악습 4가지에서 다뤘던 규칙 파일 문화와도 맞닿아 있다. 좋은 규칙과 워크플로는 여러 에이전트로 옮겨갈 수 있지만, 각 도구가 읽는 파일 위치, 명령어 방식, 훅, 권한 모델은 다르다.

따라서 결론은 간단하다. Claude Code 사용자라면 원본 academic-research-skills, Codex 사용자라면 academic-research-skills-codex를 보자. “Claude에서 쓰는 거니까 Codex에서도 그냥 복사하면 되겠지”는 반쯤 맞고 반쯤 틀린 말이다.

설치는 Claude와 Codex에서 어떻게 다를까?

설치 자체는 어렵지 않지만, 두 배포판의 성숙도와 설치 단위가 다르다. 이 차이를 글 초반에 못 박아야 독자가 헤매지 않는다.

2026년 5월 12일 기준 버전과 활동성

GitHub API로 2026년 5월 12일 확인한 원본 repo는 별 6,084개, 포크 711개, 최신 릴리스 v3.7.0이다. v3.7.0은 2026년 5월 5일 공개된 Claude Code 플러그인 패키징 릴리스다 (출처: GitHub API, v3.7.0 release).

반면 Codex sibling repo는 같은 날 기준 별 6개, 포크 0개이고, 최신 릴리스는 2026년 5월 11일의 v0.1.6이다 (출처: GitHub API, v0.1.6 release). 이 말은 Codex 지원이 없다는 뜻이 아니다. 다만 원본 Claude 배포판만큼 검증된 생태계라고 말하기에는 아직 이르다는 뜻이다.

| 항목 | Claude Code 본류 | Codex sibling |

|---|---|---|

| 권장 대상 | Claude Code CLI, VS Code, JetBrains 사용자 | Codex CLI/App에서 ARS를 쓰려는 사용자 |

| 설치 단위 | 플러그인 + 4개 스킬 | 단일 `$academic-research-suite` 스킬 |

| 최신 릴리스 | v3.7.0, 2026-05-05 | v0.1.6, 2026-05-11 |

| GitHub 규모 | 별 6,084개, 포크 711개 | 별 6개, 포크 0개 |

| 성숙도 판단 | 본류이자 문서·사용 예시가 많음 | 초기 배포판, Codex 포장 방식 확인용 |

Codex 설치는 skill-installer 경로를 따른다

Codex sibling README는 skill-installer의 GitHub 설치 스크립트를 사용하라고 안내한다. 실제 명령은 다음과 같다 (출처: academic-research-skills-codex README).

python "$HOME/.codex/skills/.system/skill-installer/scripts/install-skill-from-github.py" \

--repo Imbad0202/academic-research-skills-codex \

--ref main \

--path skills/academic-research-suite \

--method git설치 후에는 새 Codex 대화를 열고 /skills에서 academic-research-suite 하나만 보이는지 확인하라고 되어 있다. 별도의 academic-paper, deep-research, academic-pipeline 스킬이 여러 개 보이면 패키징이 꼬인 상태일 수 있다.

설치보다 중요한 것은 어떤 모드로 시작하느냐다

대학원생이 가장 많이 실수하는 지점은 설치가 아니라 첫 요청이다. “논문 써줘”로 시작하면 도구의 장점이 반쯤 사라진다. 주제가 아직 흐릿하다면 Socratic scoping부터 시작하는 편이 낫다.

대학생과 대학원생은 어디에 먼저 써야 할까?

처음부터 전체 파이프라인을 돌리기보다, 작은 연구 병목 하나에 붙이는 편이 좋다. 가장 추천하는 시작점은 문헌리뷰, 논문 요약, 방법론 비판, 인용 위생이다.

문헌리뷰는 검색보다 군집화에 쓴다

AI에게 “이 주제 논문 10개 추천해줘”라고 묻는 방식은 위험하다. 실제 논문, 오래된 논문, 맥락이 다른 논문, 존재하지 않는 참고문헌이 섞일 수 있기 때문이다. University of Glasgow의 연구자용 AI 가이드도 생성형 AI가 틀린 정보와 가짜 참고문헌을 그럴듯하게 만들 수 있다고 경고한다 (출처: University of Glasgow AI Guidance for Researchers).

더 좋은 방식은 논문을 직접 찾고, AI에게 그 목록을 구조화하게 하는 것이다.

직접 찾기

Google Scholar, Semantic Scholar, PubMed, DBpia, RISS, 학교 도서관 DB에서 논문 후보를 직접 찾는다.

서지 저장

DOI, 저자, 연도, 초록, 키워드를 Zotero나 BibTeX 형태로 모은다.

AI로 군집화

논문 목록을 주고 주제별 군집, 반복되는 연구 질문, 방법론 차이, 덜 다룬 공백을 정리하게 한다.

원문 재확인

AI가 핵심이라고 뽑은 논문은 초록이나 원문으로 다시 확인한다.

논문 요약은 세 층으로 나눈다

PDF를 넣고 “요약해줘”라고만 하면 읽기 쉬운 요약은 나오지만, 연구에 바로 쓰기는 부족하다. 최소한 기본 요약, 구조 요약, 비판 요약을 나누는 편이 낫다.

| 요약 층 | AI에게 시킬 일 | 사람이 확인할 일 |

|---|---|---|

| 기본 요약 | 연구 질문, 데이터, 방법, 결과, 한계를 5문장으로 정리 | 결과 수치와 원문 표현이 맞는지 확인 |

| 구조 요약 | 서론, 선행연구, 방법, 결과, 논의의 연결을 도식화 | 내 연구와 연결되는 논리만 남기기 |

| 비판 요약 | 표본, 변수, 통계, 외적 타당도, 저자가 말하지 않은 한계 추출 | 지도교수·전공 지식으로 과한 비판 걸러내기 |

방법론 비판은 반대편 심사위원처럼 쓴다

ARS류 워크플로의 진짜 가치는 내 편을 들어주는 데 있지 않다. 내 연구 설계를 공격하게 만들 때 더 유용하다.

문헌리뷰 AI로 쓰면 어디서 위험해질까?

가장 큰 위험은 AI가 “좋은 말”을 너무 빨리 한다는 점이다. 논문 작업에서는 매끄러운 설명보다 느린 확인이 더 중요하다.

첫 번째 위험은 가짜 참고문헌이다

MLA Style Center는 생성형 AI가 출처를 잘못 요약하거나 존재하지 않는 자료를 만들어낼 수 있으므로, AI가 준 링크나 2차 설명을 그대로 믿지 말고 원문으로 들어가 확인하라고 권한다 (출처: MLA Style Center).

이 지점에서 ARS가 말하는 citation check, integrity gate 같은 구조는 의미가 있다. 하지만 이것도 “최종 보증”이 아니라 추가 안전망이다. 논문에 들어가는 인용 책임은 여전히 제출자에게 있다.

두 번째 위험은 연구 질문이 너무 커지는 것이다

“생성형 AI가 대학생 학습에 미치는 영향”은 제목처럼 보이지만 연구 질문으로는 너무 넓다. 어떤 학생인지, 어떤 수업인지, 어떤 학습성과인지, 어떤 데이터로 측정할지 빠져 있다.

이럴 때 AI에게 제목을 더 멋지게 만들어달라고 하지 말고, 연구 가능한 형태로 줄여달라고 해야 한다.

세 번째 위험은 AI가 내 프레임 안에서만 반박하는 것이다

ARS 원문 문서도 frame-lock, sycophancy 같은 한계를 언급한다. 악마의 대변인 기능이 있어도 사용자가 강하게 밀어붙이면 AI가 너무 빨리 양보하거나, 사용자가 처음 만든 프레임 안에서만 반박할 수 있다는 뜻이다 (출처: academic-research-skills README).

그래서 AI에게 “내 주장을 반박해줘”라고만 시키면 부족하다. “이 질문 자체가 잘못 잡혔을 가능성”, “다른 학문 분야에서 보면 완전히 다른 설명”, “내가 보지 못한 이해관계자”를 따로 묻는 편이 낫다.

인용 검증과 연구윤리는 어떻게 지켜야 할까?

AI를 연구에 쓰는 순간, 좋은 결과물보다 먼저 봐야 할 것은 인용 위생과 데이터 윤리다.

참고문헌 생성은 AI보다 Zotero가 중심이어야 한다

Zotero 공식 문서는 웹에서 가져온 서지 정보가 틀릴 수 있으므로 제목, 저자, DOI, 학술지명, 날짜를 확인하라고 안내한다. 중복 항목은 삭제보다 병합을 권장한다. 그래야 컬렉션, 태그, 워드 프로세서 인용 연결을 보존할 수 있기 때문이다 (출처: Zotero Adding Items, Zotero Duplicate Detection).

실전 규칙은 단순하다. AI가 만든 참고문헌을 그대로 쓰지 않는다. DOI나 URL로 원문을 확인한다. Zotero에 저장한 뒤 메타데이터를 고친다. 본문 인용은 Zotero, Word, Google Docs 플러그인으로 넣는다.

민감한 연구 데이터는 개인용 AI에 넣지 않는다

연구 데이터에는 이름이 없어도 민감한 정보가 들어갈 수 있다. 전공, 학년, 성별, 성적, 인터뷰 발화, 실험 로그, 병력, 지역 정보가 조합되면 개인을 추정할 수 있다. University of Glasgow 가이드는 연구 데이터나 아이디어를 허가 없이 AI 도구에 넣으면 기밀성, 지식재산권, 출처 표시 문제가 생길 수 있다고 설명한다 (출처: University of Glasgow AI Guidance for Researchers).

UNESCO도 교육과 연구에서 생성형 AI를 쓸 때 인간 중심 접근, 데이터 보호, 기관 차원의 정책을 강조한다 (출처: UNESCO guidance for generative AI in education and research). 학생 입장에서는 “이 자료를 AI에 넣어도 되는가”를 먼저 물어야 한다.

AI 사용 공개는 학교와 학회 기준을 먼저 본다

AI 사용 공개는 분야와 기관마다 다르다. 어떤 수업은 사용 범위를 엄격히 제한하고, 어떤 학회는 AI 사용 고지를 요구한다. ARS에는 disclosure mode가 있지만, 그것이 학교 규정을 자동으로 대체하지는 않는다.

공개 논문과 공개 초록은 비교적 안전하게 넣을 수 있지만, 인터뷰 원문, 설문 원자료, 미공개 공동연구 데이터, 지도교수 프로젝트 자료는 허락 없이 AI에 넣지 않는 편이 맞다.

NotebookLM, Zotero, 일반 챗봇과는 어떻게 나눠 써야 할까?

Academic Research Skills를 모든 연구 도구의 대체재로 보면 안 된다. 오히려 NotebookLM, Zotero, 일반 챗봇과 역할을 나눌 때 실전성이 올라간다.

NotebookLM은 소스 기반 리서치에 강하다

NotebookLM 사용법 2026에서 정리했듯, NotebookLM은 PDF, 웹페이지, 유튜브, 문서 같은 소스를 묶어두고 그 안에서 답하게 만드는 데 강하다. 즉 “내가 올린 자료 안에서만 근거를 찾아라”가 중요한 작업에 좋다.

반면 Academic Research Skills는 연구 단계, 논문 구조, 리뷰, 수정, 최종화처럼 작업 순서와 역할 분담이 중요한 흐름에 강하다. 둘은 경쟁 도구가 아니라 서로 다른 층이다.

Zotero는 인용 데이터베이스의 중심이다

Zotero는 논문 PDF와 서지 메타데이터를 관리하는 중심이다. AI는 Zotero를 대체하기보다 Zotero에서 뽑은 BibTeX, CSV, 문헌 목록을 검토하는 보조자에 가깝다.

예를 들어 AI에게 “중복 의심 항목”, “DOI가 비어 있는 항목”, “학술지명 표기가 이상한 항목”, “내 문헌리뷰 주제와 맞지 않는 항목”을 표시하게 할 수 있다. 하지만 최종 수정은 Zotero 쪽에서 해야 한다.

Codex와 Claude는 반복 워크플로를 고정하는 데 맞다

OpenAI Codex 문서는 스킬을 반복 가능한 워크플로의 저작 형식으로 설명한다. Codex는 명시 호출이나 작업 설명 매칭으로 스킬을 활성화할 수 있고, 스킬은 지시문과 참조 문서, 선택적 스크립트를 포함할 수 있다 (출처: OpenAI Codex Skills).

이 관점에서 보면 Academic Research Skills의 장점은 특정 답변 하나가 아니라 “연구할 때 매번 해야 하는 루프를 도구화한다”는 데 있다. 큰 자료를 구조화하는 흐름은 Graphify 실전 구축에서 다룬 지식 그래프/컨텍스트 관리와도 연결된다.

또한 OpenAI의 Codex use case 목록은 지식 작업, 데이터 분석, 반복 워크플로를 스킬로 저장하는 사용례를 별도로 분류한다. 연구 도구를 “답변기”가 아니라 “반복 절차”로 보는 해석은 Codex 쪽 문서와도 잘 맞는다 (출처: Codex use cases).

| 도구 | 가장 잘 맞는 일 | 조심할 점 |

|---|---|---|

| Academic Research Skills | 연구 질문, 논문 구조, 리뷰, 무결성 체크를 단계화 | Claude 본류와 Codex sibling을 구분해야 함 |

| NotebookLM | 내가 넣은 자료 안에서 근거 기반 요약과 비교 | 소스 선택이 편향되면 답도 편향됨 |

| Zotero | 서지 정보, PDF, DOI, 인용 연결 관리 | 가져온 메타데이터를 직접 확인해야 함 |

| 일반 챗봇 | 짧은 설명, 아이디어 브레인스토밍, 문장 다듬기 | 근거 확인과 참고문헌 생성에는 취약함 |

| Codex/Claude Code | 반복 워크플로를 스킬과 명령으로 고정 | 권한과 데이터 범위를 좁혀야 함 |

한계와 라이선스는 무엇을 조심해야 할까?

좋은 도구일수록 한계도 앞에서 봐야 한다. 특히 학술 작업은 잘못된 인용 하나가 글 전체의 신뢰를 흔든다.

CC BY-NC 4.0은 상업적 사용에 조심해야 한다

원본 repo의 라이선스 파일과 플러그인 메타데이터는 CC BY-NC 4.0을 표시한다. GitHub API의 license 필드는 NOASSERTION/Other로 잡히지만, repo의 실제 라이선스 파일은 비상업 라이선스다 (출처: LICENSE, plugin.json, GitHub API).

개인 학습, 연구 보조, 비상업적 실험은 문맥상 자연스럽지만, 유료 컨설팅 패키지, 사내 유료 배포, SaaS 래핑, 교육 상품화는 별도 허락이나 법적 검토가 필요할 수 있다.

Codex sibling은 아직 초기 배포판이다

Codex sibling 배포판이 있다는 사실은 매우 반갑다. 하지만 2026년 5월 12일 기준으로 별 6개, 포크 0개인 초기 패키지다. 즉 “Codex에서도 공식적으로 완전히 같은 경험”이라고 말하면 과장이다.

정확한 표현은 이렇다. 워크플로 콘텐츠는 Codex에서 쓸 수 있게 포장되어 있다. 다만 Claude Code 본류보다 초기 단계이고, 사용자는 설치 후 /skills와 간단한 라우터 테스트로 동작을 확인해야 한다.

AI 검증은 최종 검증이 아니다

ARS가 무결성 게이트와 citation check를 갖췄다고 해도, 논문 책임은 여전히 사람에게 있다. AI가 “검증 완료”라고 말해도 원문 DOI, 인용 페이지, 데이터 표, 통계 코드, IRB 여부는 직접 확인해야 한다.

이 지점은 GPT-5.5 총정리에서 다룬 Codex형 에이전트 흐름과도 같다. 모델이 더 오래 일하고 더 많은 도구를 써도, 최종 판단을 맡겨도 된다는 뜻은 아니다. 오히려 모델이 더 많은 일을 할수록 검증 로그와 경계 설정이 더 중요해진다.

FAQ

Academic Research Skills가 논문을 처음부터 끝까지 자동으로 써주나?

Claude Code와 Codex 중 어디에 설치하는 게 좋나?

학부생도 쓸 만한가?

한국어 논문에도 쓸 수 있나?

AI 사용을 숨기는 데 도움이 되나?

상업적으로 써도 되나?

결론: 논문을 빨리 쓰는 도구보다, 덜 틀리게 만드는 도구다

Academic Research Skills의 매력은 “논문을 빨리 완성한다”가 아니라 “연구자가 놓치기 쉬운 검증 지점을 반복해서 드러낸다”는 데 있다.

한 줄 결론

대학생과 대학원생에게 Academic Research Skills는 대필 도구가 아니라 연구 질문, 문헌리뷰, 방법론 비판, 인용 위생을 반복 가능한 루프로 바꾸는 도구다.

Claude Code나 Codex를 이미 쓰고 있고, 논문 주제 정리·문헌리뷰·피어리뷰 대비·인용 점검을 한 흐름으로 묶고 싶은 대학원생이라면 테스트할 가치가 높다. 반대로 단순 문장 교정이나 과제 초안만 원한다면 너무 무거울 수 있다.

1. 환경부터 고른다

Claude Code면 원본 repo 플러그인, Codex면 sibling repo의 academic-research-suite를 본다.

2. 작은 병목에 먼저 붙인다

처음부터 전체 논문 파이프라인을 돌리지 말고 연구 질문, 문헌리뷰, 방법론 비판 중 하나를 고른다.

3. 원문과 DOI를 확인한다

AI가 준 요약과 참고문헌은 최종 자료가 아니라 확인해야 할 초안으로 취급한다.

4. 민감정보를 넣지 않는다

인터뷰 원문, 설문 원자료, 미공개 공동연구 데이터는 허락 없이 AI 도구에 넣지 않는다.

5. 사용 공개 기준을 확인한다

수업, 지도교수, 학회, 저널의 AI 사용 지침을 먼저 확인하고 필요한 경우 명시한다.

스크린샷이 있으면 글 신뢰도가 더 올라가는 구간도 있다. Claude Code에서 /ars-plan을 실행한 첫 Socratic 질문 화면, Codex에서 $academic-research-suite가 /skills에 보이는 화면, 그리고 citation check나 integrity report가 실제로 뜬 화면이다. 지금 글은 본문용 인포그래픽으로 충분히 공개 가능하지만, 실사용 화면이 생기면 ImageGuide로 보강하면 좋다.